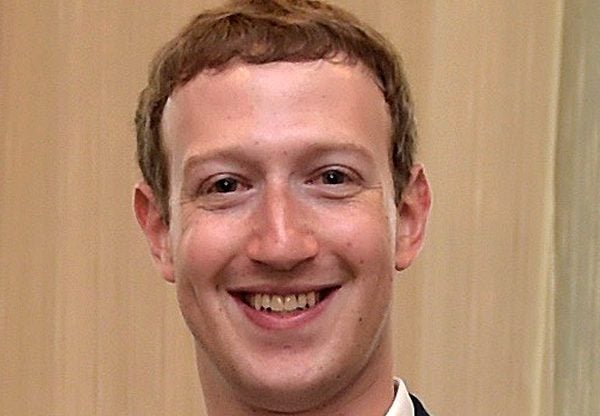

צוקרברג: "האלגוריתמים של פייסבוק יזהו מחבלים"

מייסד החברה התווה תוכנית שתאפשר לתוכנה מבוססת בינה מלאכותית לבחון תוכן שהועלה לרשת החברתית הדומיננטית בעולם כדי לזהות בו מגמות מסוכנות, והתנצל על הורדת התצלום של ילדת הנפלם

מארק צוקרברג, מנכ"ל ומייסד פייסבוק (Facebook), הציג באחרונה תוכנית עתידנית מבוססת בינה מלאכותית (AI), שנועדה ללוחמה באלימות ובטרור ברשת החברתית. בפוסט שפרסם הוא תיאר במכתב את תוכניתו החדשה וכתב שבסופו של דבר, האלגוריתמים יהיו מסוגלים לזהות טרור, אלימות ובריונות ברשת, ואף למנוע התאבדות.

לדבריו, פיתוחם של האלגוריתמים במסגרת התוכנית ייקח, לצערו, שנים. התוכנית התקבלה בברכה על ידי מוסדות לבטיחות האינטרנט, שהעבירו בעבר ביקורת רבה על פייסבוק לגבי האופן שבו טיפלה בפרסומים שהופיעו בה ותיארו אלימות קיצונית.

הורדת התמונה של ילדת הנפלם – טעות

בפוסט, בן ה-5,500 מילים, דן צוקרברג גם בעתידה של פייסבוק. בין השאר, הוא כתב שבלתי אפשרי לסקור את מיליארדי ההודעות והמסרים שמועלים לפלטפורמה מדי יום ביומו. "המורכבות של הסוגיות שזיהינו עלתה על התהליכים הקיימים שאנחנו מפעילים לשליטה בקהילה", ציין.

בנוסף, התוודה המנכ"ל כי פייסבוק עשתה בעבר טעויות בתוכן שהסירה מהאתר. הוא מציין בהקשר זה את הסרת הסרטונים הקשורים לתנועת שחרור האפרו-אמריקנים Black Lives Matter, כמו גם את עניין תצלום ילדת הנפלם ההיסטורי מווייטנאם, שפייסבוק צנזרה כ-"תצלום עירום". הוא ציין שאלה הן דוגמאות ל-"טעויות" בתהליך הקיים.

פייסבוק ספגה ביקורת גם ב-2014, בעקבות דיווחים על כך שאחד הרוצחים של החייל לי ריגבי – שראשו נערף בסכין קצבים באמצע הרחוב בלונדון – פרסם ברשת את כוונותיו לרצוח חייל חודשים לפני הפיגוע, ופרסום זה לא צונזר.

לדבריו, "אנחנו חוקרים מערכות שיכולות לקרוא טקסט ולהסתכל בתמונות ובקטעי וידיאו על מנת להבין אם עלול להתבצע משהו מסוכן. זה נמצא עדיין בשלב מוקדם מאוד בפיתוח, אבל התחלנו להסתכל על תוכן מסוים, וזה כבר משרת כשליש מכלל הדיווחים לצוותים הבוחנים תוכן".

"כרגע, אנחנו מתחילים לחפש דרכים להפעלת הבינה המלאכותית לצורך הבדלה בין כתבות חדשותיות על טרור לתעמולת טרור", הוסיף.

מסננים אישיים לתוכן ברשת החברתית

צוקרברג כתב כי המטרה הסופית שלו היא לאפשר לאנשים לפרסם כאוות נפשם, במסגרת החוק, עם אלגוריתמים לזיהוי מה שהועלה – כך שמשתמשים יוכלו לסנן את פיד החדשות שלהם ולהסיר את סוגי הפוסטים שאין ברצונם לראות. "איפה עובר הקו שלכם – בעירום? באלימות? בתוכן גרפי? בתועבה? מה שתחליטו יהיה ההגדרות האישיות שלכם", הסביר.

מי שלא יחליט ולא יקבע מסנני פיד כרצונו, יקבל את עזרת הבינה המלאכותית בבחירת התוכן המתאים לו במיוחד. היא תחליט על כך על פי מאפיינים שונים, למשל האזור שבו נמצא המשתמש.

"הפוסט ממחיש שפייסבוק מגיבה לטענות"

התוכנית של צוקרברג התקבלה בברכה גם על ידי המוסד לבטיחות המשפחה באינטרנט, ה-FOSI (ר"ת Family Online Safety Institute), החבר במועצה המייעצת לנשואי בטיחות של פייסבוק עצמה. הארגון ביקר בעבר את הרשת החברתית על כך שאפשרה לקטעי וידיאו שמתעדים עריפת ראשים להתנגן אוטומטית ובלי שום אזהרה באתר.

"פוסט זה ממחיש שפייסבוק מגיבה לדאגות ושהיא עובדת קשה בכדי למנוע ולהגיב להתעללות ולחומר בלתי הולם בפלטפורמה", אמרה עו"ד ג'ניפר הנלי, היועצת המשפטית הבכירה של ה-FOSI. "אני גם ממש אוהבת את היכולת של משתמשים להתאים את החוויות האישיות שלהם עם ההתפתחויות הללו. חשוב להעניק למשתמשים שליטה על החוויות שלהם אונליין, וכלים ובקרות נוספים יהיו מועילים".

תגובות

(0)