כאשר בינה מלאכותית פוגשת תוקפים בשר ודם

כתב: עופר שמואלי, מנהל פעילות ההדרכה ושירותי המומחה ב-SecureWave, המפיצה בישראל של Vectra AI.

Non Malware Techniques

כשמדברים על ציד איומים בעולמות הסייבר, בדרך כלל עוסקים בזיהוי של תבניות ומאפיינים של האיום, כדוגמת חריגה מספים (Thresholds), חתימות של נוזקות מוכרות, אנליזה של התנהגות לא נורמלית ועוד.

זה מתקיים גם כיום, אך תוקפים מתוחכמים משתמשים בשיטות ובטכניקות חדשות על מנת לזרוע הרס בארגון. כיצד? באמצעות התמזגות בפעילות הלגיטימית של הארגון, גנבת זהויות, ניצול מערכות קיימות ושימוש בקוד זדוני שאינו יורד כקובץ למחשבים (File less), אלא מוזרק לתהליכים קיימים כ-DLL בתוך Process לגיטימי. התוצאה: מערכות שנולדו להתמודד עם נוזקות נדרשות כיום להתמודד עם מגוון חדש של איומים שאינם כאלה (Non malwares) בטכניקות שלהם. קטגוריה חדשה בפתרונות אבטחת המידע, שעונה לשם NDR, משתמשת בבינה מלאכותית על מנת לנטר את התעבורה בארגון, להתמודד, לנתח ולהסיר את האיומים הללו.

כאשר בינה מלאכותית נכנסת לתמהיל איומי הסייבר בשלבי המניעה, היא בוחנת את המאפיינים של האיום, אבל היא מסתכלת גם על התוצאה. מהי המטרה המרכזית? השתלטות מרחוק, מחיקת קבצים, הצפנת קבצים ועוד.

Vectra AI היא מובילה עולמית ב-NDR (ר"ת Network Detection and Response) ומערכת ה-Cognito AI שלה יודעת להסתכל על התעבורה בארגון – בענן ובדטה סנטר, להעשיר אותה במידע נוסף מבוסס לימודי מכונה ולהתריע על איומים.

שרשרת של אירועים

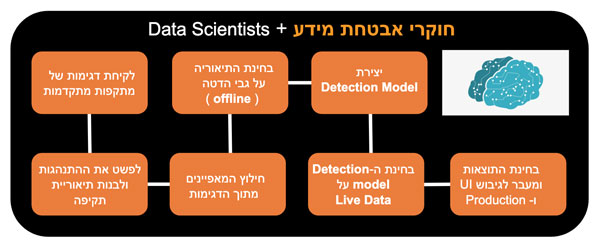

כשאנחנו חושבים על AI במסגרת של Threat Detection, חייבים לבנות את התמהיל הנכון שבין מדעני הנתונים למומחי אבטחת המידע. ברגע שהשניים מתמזגים, אנחנו יכולים להשתמש באלגוריתם שנוצר כמעין ספר מתכונים בינארי לאיתור נוזקות ברמת ודאות גבוהה.

בניית האלגוריתם מורכבת מהרצף הבא, שבו מעורבים שני הצדדים. לשם ההפשטה, נעלמו מהתרשים שלבים נוספים בבניית האלגוריתם.

מהי התוצאה הסופית?

כשזה נוגע לבינה מלאכותית חשובה לא רק הדרך, אלא גם התוצאה הסופית. דוגמה לכך היא השתלטות מרחוק על מכונה. ישנם המון כלים לכך – Any desk, Team viewer, Log Me In ועוד רבים וטובים. יש גם הרבה כלים שמפותחים בלעדית לטובת מתקפה נקודתית, כך שאין טעם לנסות ולחפש מאפיינים של כלי מסוים, אלא ללמד את המכונה (באמצעות לימודי מכונה) כיצד הכלים הללו עובדים, על מנת שבכל מקרה שבו תתבצע מתקפה שמטרתה השתלטות מרחוק, היא תדע לזהות את מטרת המתקפה. אנחנו משתמשים בבינה מלאכותית כדי לייצר העתק של התנהגות אנושית.

מהו הקונטקסט של המתקפה?

דוגמה נוספת לאופן שבו הבינה המלאכותית באה לידי ביטוי היא כאשר משתמש ניגש לשרת או למחשב אחר בארגון. זה יכול להיות משתמש לגיטימי, אדמין של המערכת או תוקף שמבצע Lateral Movement. השאלה שמנגנוני ה-AI שואלים את עצמם נוגעת לקונטקסט, כלומר – מה קרה לפני ואחרי שהמשתמש ניגש לשרת:

- האם הוא סרק את הרשת בחיפוש אחר שרתים נוספים?

- האם במחשב שניגש לשרת רצו Processes חשודים, לא חתומים?

- מאיזה מחשב הגיעה הבקשה להתחבר?

- אילו Events התחוללו ובאיזו תכיפות?

- האם ניסיון הגישה נעשה באמצעות סקריפט שהתחולל מתוך אפליקציה תמימה?

- האם זה נעשה באמצעות Scheduled Task?

הקונטקסט שבו נעשה ניסיון הגישה יכול לגלות האם מדובר בתוקף או במשתמש לגיטימי. לכל התנהגות כזו מצמידים Threat Score, כך שברגע שבו מתבצע סדר פעולות שמבחינת ה-Score שלו הוא גבוה, מתקבלת התראה מדויקת ולא הרבה אירועי False Positive, דוגמת תוכנת Adware שרמת הסיכון שלה למערכת נמוכה יחסית.