OpenAI מציעה לגייס את ChatGPT לסינן תוכן לא ראוי מאתרים

מיתון תוכן, שאתרים ורשתות חברתיות מבצעים כדי לשמור על הגולשים מחשיפה לתכנים קשים, אלימים, מסיתים ושקריים, דורש כוח אדם ומאמץ ● האם הבינה המלאכותית היוצרת של OpenAI יכולה לעשות זאת במקום בני האדם?

OpenAI פיתחה דרך חדשה להשתמש ב-ChatGPT שלה, והפעם לשם מיתון וניהול תוכן באינטרנט.

כידוע, מיתון ואף סינון תוכן לא רצוי, שאתרים ורשתות חברתיות מבצעים כדי לשמור על הגולשים מחשיפה לתכנים קשים, אלימים, מסיתים ושקריים, דורש כוח אדם ומאמץ. הרשתות החברתיות עושות הרבה, לפחות לטענתן, כדי לאתר תוכן מסוכן או לא ראוי, פייק ניוז וכן תכנים שנוגדים את מדיניותן, אבל כל משתמש יודע שלמרות זאת – התוכן הרעיל "חוגג" בהן. מעבר לכך הפלטפורמות החברתיות נאלצות להחזיק ממתני תוכן רבים במיוחד, כולל צוותים ייעודיים בכל מדינה, שיודעים את השפה ואת המטען התרבותי-פוליטי במקום המסוים, ולכן יודעים לבצע את תפקידם היטב.

האם לצ'טבוט פתרונים?

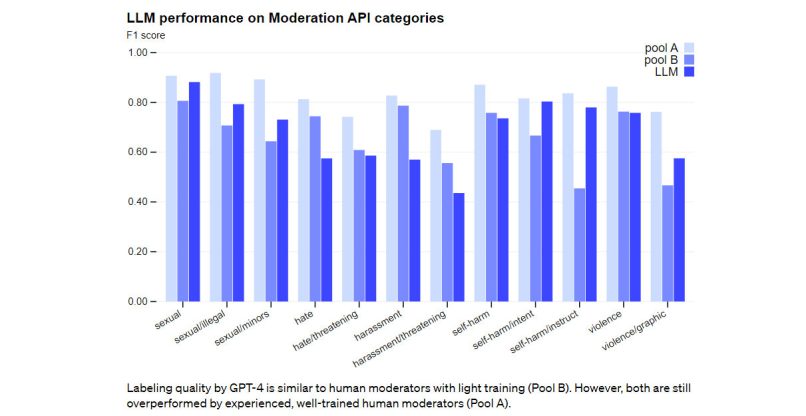

ממתני התוכן, בעיקר בפלטפורמות המדיה החברתית, מתבקשים לזהות ולהסיר תוכן מזיק או לא חוקי, כמו כזה שבו מופיעה התעללות מינית בילדים או דברי שטנה וכדומה. התפקיד תובעני והתוצאה היא שהביצוע אינו מושלם. אלא שלדברי OpenAI, יש לאתרים ולמדיה החברתית אפשרות להיעזר ביכולות המאוד מתקדמות של מודל השפה הגדול המאייש את ChatGPT שלה, לצורך ביצוע המטלה בהצלחה ובתוך צמצום משמעותי של בני האנוש שנדרש להעסיק בשביל לבצעה.

בנוסף, השימוש ביכולות GPT-4 לביצוע המשימה יכול לסייע בנושא שאמנם אינו מככב בכותרות, אך שכבר שמענו עליו תלונות רבות ממתני התוכן האנושיים – הפגיעה הרגשית והעקה שהם חווים לעתים קרובות עקב החשיפה האינטנסיבית לתוכן מזיק או מטריד.

יישום הטכניקה אפשרי למי שעובד מול -API של OpenAI. על המשתמש לספק לצ'טבוט בגרסת GPT-4 שלו, לשם שינון ולמידה, את הכללים המנחים של האתר או השירות שעליו מתבקש מיתון וסינון התוכן. לאחר מכן, מספקים לצ'אטבוט מבחן עם סט של דוגמאות של תוכן שיכול להפר או לא להפר את המדיניות המסוימת. על ידי השוואת החלטתיו של הבוט לאלה של בני האנוש, מומחי המדיניות של השירות – בין אם הוא אתר או למשל קבוצה ברשת חברתית – יכולים לזהות אי-התאמות ולבקש מהכלי היוצר להסביר את נימוקיו, כמו גם לעדכן אותו בטעותו. הרעיון הוא לחזור על התהליך הזה מספר פעמים, עד שהתוצאה תיחשב כאיכותית ואפשר יהיה להמיר את כוח האדם האנושי המטפל בנושא ב-ChatGPT.

OpenAI טוענת שתהליך זה יכול להפחית את הזמן שלוקח להטמיע מדיניות ניהול תוכן חדשה מחודשים – לשעות ספורות בלבד. בנוסף לדבריה, GPT-4 מסוגל לפרש כללים וניואנסים בתיעוד ארוך של מדיניות תוכן, ולהסתגל באופן מיידי לעדכוני מדיניות, ולפיכך הוא עשוי לספק תיוג עקבי ויעיל יותר של תוכן.

אבל לפני שכל שירות או אתר יזדרז להעביר את עבודות ניהול התוכן שלו לשיטה הדיגיטלית החדשה, חשוב לציין כי כבר ידוע שמודלים גדולים של שפה עלולים להיות חשופים להטיה ועקב כך להיות מוטים בעצמם. לפיכך, כמו בכל יישום של AI, התוצאות של הפעולה חייבות להיות במעקב קפדני, ולקבל אישור סופי על ידי בני אדם. לפחות בינתיים.

בפוסט אודות היכולות הללו, שעלה לאתר OpenAI, צוין כי: "אנו מאמינים שזה (השימוש המסוים בצ'טבוט – ג"פ) מציע חזון חיובי יותר של עתיד הפלטפורמות הדיגיטליות, שבו AI יכולה לעזור למתן את התעבורה המקוונת בהתאם למדיניות הספציפית לפלטפורמה ולהקל על הנטל הנפשי של מספר רב של מנחים אנושיים". החוקרים החתומים על הפוסט, שתוכלו לשמוע גם מסבירים על היכולות בסרטון המצורף לכתבה, המשיכו וציינו כי "כל מי שיש לו גישה ל-API של OpenAI יכול ליישם שיטה זו כדי ליצור מערכת ניהול בסיוע בינה מלאכותית משלו".

לסיכום ניתן לומר כי למערכת ניהול התוכן החדשה הנשענת על GPT-4 יש אמנם פוטנציאל לשפר משמעותית את היעילות והאפקטיביות של ניהול תוכן בפלטפורמות דיגיטליות, אבל היא בכל זאת לא יכולה להביא לפיטורי כל מי שנמצא בצוותי הממתנים. השימוש בה עשוי לסייע בהפחתת עומס העבודה המוטל על הסוקרים האנושיים, אבל מאחר שה-AI הג'נרטיבית נמצא עדיין בשלבים מוקדמים, ישנן בינתיים בעיות שמחייבות פיקוח אנושי הדוק על התוצאות.

תגובות

(0)