מיקרוסופט מבטלת את הגישה לכלי לזיהוי רגשות בתמונות וסרטונים

על רקע שינוי במדיניות האתיקה של הבינה המלאכותית, מיקרוסופט שמה דגש על אחריות ופיקוח אנושי מוגבר על המשתמשים בשירותיה ומגבילה את הגישה הציבורית לכמה כלים, כמו זיהוי רגשות ויצירת קול סינתטי

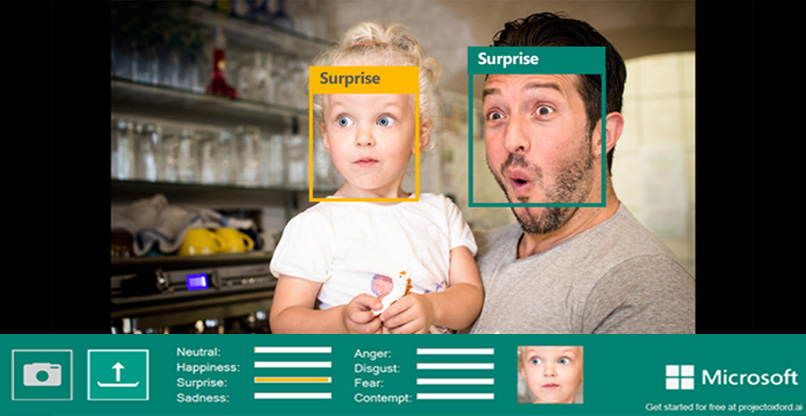

מיקרוסופט מבטלת בהדרגה את הגישה הציבורית לכמה כלים מבוססי בינה מלאכותית לניתוח פנים – בהם הכלי המתיימר לזהות רגשות בסרטונים ובתמונות.

כלים מעין אלה ל"זיהוי רגשות" זכו לביקורות שליליות של מומחים, שלטענתם הבעות פנים שנחשבות אוניברסליות הן שונות בקרב אוכלוסיות שונות, כמו גם שאין זה מדעי להשוות גילויים חיצוניים של רגשות עם תחושות פנימיות.

ההחלטה היא חלק משינוי גדול שמיקרוסופט מבצעת במדיניות האתיקה של הבינה המלאכותית. תקני הבינה המלאכותית המעודכנים של החברה שמים דגש על אחריות ופיקוח אנושי מוגבר על המשתמשים בשירותיה והיכן מיושמים כלים מעין אלה.

המשמעות המעשית היא שמיקרוסופט מגבילה את הגישה לחלק מהכלים של זיהוי פנים (המכונים Azure Face) וגם תסיר לחלוטין חלק מהם.

המשתמשים יצטרכו להגיש בקשה להשתמש ב-Azure Face לזיהוי פנים, למשל, ולהודיע לחברה איך והיכן בדיוק הם יפרסו את המערכות שלה. מקרי שימוש מסוימים, עם פוטנציאל פחות מזיק (כמו טשטוש אוטומטי של פנים בתמונות ובסרטונים) – יישארו פתוחים.

בנוסף להסרת הגישה הציבורית לכלי זיהוי הרגשות שלה, מיקרוסופט גם מוציאה משימוש את היכולת של Azure Face לזהות "תכונות כמו מין, גיל, חיוך, שיער פנים, שיער ואיפור".

בפוסט בבלוג של החברה, כתבה נטשה קרמפטון, מנהלת הבינה המלאכותית במיקרוסופט, כי "מומחים בחברה ומחוצה לה הדגישו את היעדר הקונצנזוס המדעי הנוגע להגדרה של 'רגשות', את האתגרים בהכללת מסקנות במקרי שימוש, אזורים ודמוגרפיה, ואת חששות הפרטיות הגוברים סביב סוג זה של יכולת".

עם זאת, על אף שמיקרוסופט מפסיקה את הגישה הציבורית לתכונות הללו, היא תמשיך להשתמש בהן לפחות באחד מהמוצרים שלה: אפליקציה בשם Seeing AI, שמשתמשת בראיית מכונה כדי לתאר את העולם עבור אנשים עם לקות ראייה. בפוסט בבלוג, מנהלת קבוצת המוצר הראשית של מיקרוסופט עבור Azure AI, שרה בירד, כתבה, כי כלים כגון זיהוי רגשות "יכולים להיות בעלי ערך כאשר משתמשים בהם עבור סט של תרחישי נגישות מבוקרים". לא ברור אם הכלים האלה ישמשו במוצרים אחרים של מיקרוסופט.

עוד הודיעה החברה על הגבלות דומות לתכונת הקול העצבי המותאם שלה, המאפשרת ללקוחות ליצור קולות בינה מלאכותית המבוססים על הקלטות של אנשים אמיתיים (המכונה לפעמים זיוף שמע עמוק).לכלי "יש פוטנציאל מרגש בחינוך, נגישות ובידור", כותבת בירד, אך היא מציינת, כי "קל גם לדמיין כיצד ניתן להשתמש בו כדי להתחזות לדוברים ולהונות את המאזינים באופן בלתי הולם".

תגובות

(0)