WALL-E: מודל בינה מלאכותית של מיקרוסופט, שמחקה דיבור של אדם

WALL-E הוא מודל טקסט לדיבור, שיכול לחקות דיבור של אדם באמצעות דגימת קול של שלוש שניות, ואף יכול לשמר את הטון הרגשי ואת הסביבה האקוסטית של הדובר

בסוף השבוע הכריזו חוקרי מיקרוסופט על מודל בינה מלאכותית חדש של טקסט לדיבור בשם VALL-E, שיכול לחקות באופן מדויק את קולו של אדם באמצעות דגימת אודיו של שלוש שניות. ברגע שהוא לומד קול ספציפי, VALL-E יכול לסנתז דיבור של אותו אדם אומר כל דבר – ולעשות זאת בצורה שתנסה לשמר את הטון הרגשי של הדובר.

יוצרי המודל מעריכים, שניתן להשתמש ב-VALL-E עבור יישומי טקסט לדיבור באיכות גבוהה, עריכת דיבור – שבה ניתן לערוך הקלטה של אדם ולשנות מתמלול טקסט (לגרום לו לומר משהו שהם לא אמרו במקור), ויצירת תוכן שמע בשילוב עם דגמי בינה מלאכותית אחרים כמו GPT-3.

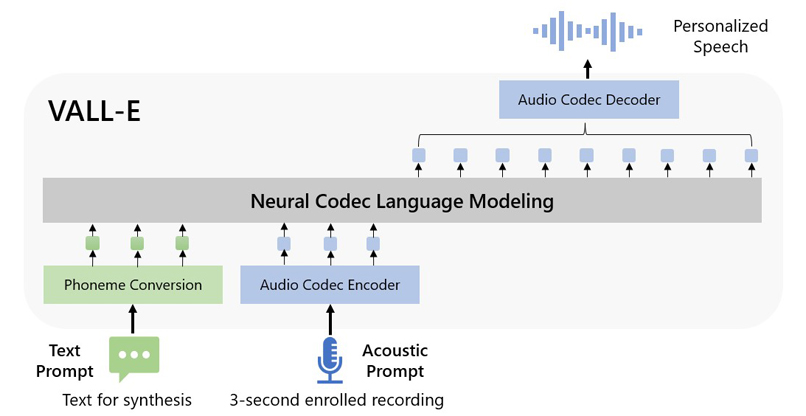

מיקרוסופט מכנה את VALL-E "מודל עצבי לקידוד שפה", והוא מבוסס על טכנולוגיה בשם EnCodec, שעליה הכריזה מטא באוקטובר 2022. בניגוד לשיטות טקסט-לדיבור אחרות, שבדרך כלל מסנתזות דיבור על ידי מניפולציה של צורות גל, VALL-E יוצר קודי קידוד אודיו נפרדים מטקסט והנחיות אקוסטיות. המודל בעצם מנתח איך אדם נשמע, מפרק את המידע הזה לרכיבים נפרדים (הנקראים "אסימונים") הודות ל-EnCodec, ומשתמש בנתוני אימון כדי להתאים למה שהוא "יודע" לגבי האופן שבו הקול הזה היה נשמע אם היה משמיע ביטויים שונים ממה שנאמר בדגימת שלוש השניות.

מיקרוסופט אימנה את יכולות סינתזת הדיבור של VALL-E על ספריית אודיו בשם LibriLight, שנבנתה על ידי מטא. היא מכילה 60,000 שעות של דיבור בשפה האנגלית של יותר מ-7,000 דוברים, שרובם נשלפים מספרי אודיו ציבוריים של LibriVox. כדי ש-VALL-E יפיק תוצאה טובה, הקול בדגימה של שלוש השניות חייב להתאים לקול בנתוני האימון.באתר לדוגמה VALL-E, מיקרוסופט מספקת עשרות דוגמאות אודיו של מודל הבינה המלאכותית בפעולה ומציגה את התוצאות.

נוסף על שימור הגוון הקולי והטון הרגשי של הדובר, VALL-E יכול גם לחקות את "הסביבה האקוסטית" של האודיו. לדוגמה, אם הדגימה הגיעה משיחת טלפון, פלט האודיו ידמה את המאפיינים האקוסטיים והתדרים של שיחת טלפון בפלט המסונתז שלה. הדגימות של מיקרוסופט מדגימות, ש-VALL-E יכול גם ליצור וריאציות בטון הקול.

אולי בגלל היכולת של VALL-E לגרום להונאה או סתם לפעולות "שובבות, מיקרוסופט לא סיפקה את הקוד VALL-E כדי שאחרים יוכלו להתנסות בו. נראה כי החוקרים מודעים לנזק החברתי הפוטנציאלי שטכנולוגיה זו עלולה לגרום. החוקרים כותבים במסקנתם, כי "מכיוון ש-VALL-E יכול לסנתז דיבור ששומר על זהות הדובר, הוא עלול לשאת סיכונים פוטנציאליים בשימוש לרעה במודל, כגון זיוף זיהוי קולי או התחזות לדובר ספציפי. כדי להפחית סיכונים כאלה, אפשר לבנות מודל זיהוי שיודיע האם קליפ אודיו סונתז על ידי VALL-E. אנו גם ניישם את עקרונות הבינה המלאכותית של מיקרוסופט בפיתוח מודלים נוספים".

היי

מה הקשר של זה לבינה מלאכותית? חיקוי של אות כלשהו, של מכונה, של חיה, זה תוכנה פרופר. לומדים אות, ומשחרין ברמה כזו או אחרת. היו סמפלרים שדגמו כלי נגינה, וחלק מהכלים ממש טוב. וגם קול אדם, וזה יותר קשה כי יש גם עיצורים, וכו. יותר מורכב. אבל, תוכנה זה תוכנה, ותלויה באלגוריתמים ומי שכתב. זה שמחקים קול אדם, לא עושה את זה לבינה מלאכותית. הייפ של מושג שיווקי.

אין לי כוח להיכנס לפרטים אבל פשוט סמוך עליי זה דורש בינה מלאכותית